Wenn Maschinen uns verstehen – warum wir ihnen trotzdem wieder JSON geben

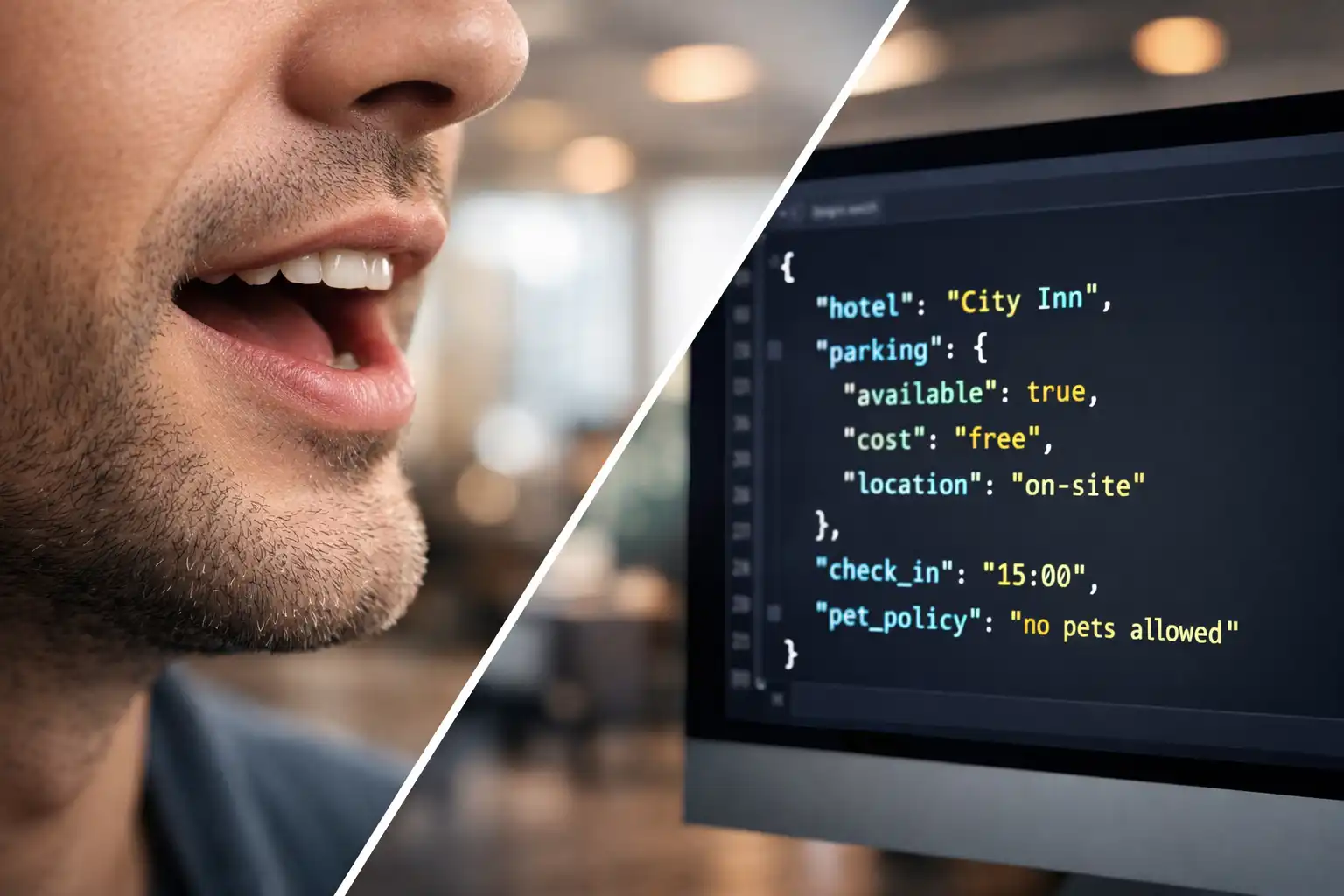

Es fühlt sich zunächst wie ein Rückschritt an. Nach Jahrzehnten technischer Entwicklung können wir erstmals natürlich mit Maschinen sprechen. Wir formulieren Fragen in Alltagssprache, wir denken laut, wir erklären Zusammenhänge – und Large Language Models verstehen uns. Sie erfassen Kontext, Bedeutungen, implizite Annahmen.

Und genau jetzt beginnen wir wieder, Inhalte in strukturierte, maschinenlesbare Formate zu pressen: JSON. JSON-LD. Schemas. Typen. Felder u.s.w.

Warum bauen wir wieder Strukturen, wenn wir sie doch gerade überwunden haben? Die kurze Antwort: Weil wir zwei völlig unterschiedliche Arten von „Verstehen“ miteinander verwechseln.

Zwei Arten von Verstehen – und nur eine davon beherrschen LLMs wirklich gut

1. Sprachliches Verstehen (die große Stärke von LLMs)

LLMs sind hervorragend darin,

- Bedeutungen aus Kontext zu erschließen

- Umschreibungen und Synonyme zu erkennen

- implizite Aussagen zu interpretieren

- dialogisch nachzufragen und Antworten anzupassen

Wenn jemand fragt: „Kann ich mein Auto bei euch abstellen?“ versteht eine KI: Parken, Auto, Unterkunft, Aufenthaltsdauer, implizite Erwartung. Das ist neu. Das ist mächtig! Und genau das ist die eigentliche Revolution von LLMs.

2. Faktisches und normatives Verstehen (eine strukturelle Schwäche)

Was LLMs nicht sicher wissen können, ist etwas anderes:

- Ist diese Aussage offiziell?

- Ist sie noch gültig?

- Stammt sie vom Betreiber selbst?

- Hat sie rechtliche oder organisatorische Verbindlichkeit?

Der Satz: „Parkplätze sind kostenlos.“ ist für eine KI semantisch klar – aber normativ völlig offen.

Ist das:

- ein Marketingtext?

- ein Blogbeitrag?

- ein Nutzerkommentar?

- eine veraltete Information?

LLMs arbeiten probabilistisch. Sie raten sehr gut – aber sie wissen nicht sicher, was sie ernst nehmen dürfen. Und genau hier beginnt der eigentliche Sinn von Struktur.

JSON-LD ist keine Verständnishilfe – sondern ein Autoritätsmarker

Der entscheidende Perspektivwechsel lautet: Strukturierte Daten sind nicht dafür da, Sprache verständlich zu machen. Dafür brauchen wir keine LLMs. Strukturierte Daten sind dafür da, Verantwortung zu markieren. JSON-LD sagt nicht „So musst du diesen Text lesen.“, sondern „Das hier ist eine explizite, überprüfbare Aussage des Seitenbetreibers.“ Oder noch klarer:

- Natürliche Sprache transportiert Bedeutung

- Strukturierte Daten transportieren Autorität

Das ist kein Rückschritt. Das ist einfach (sinnvolle) Arbeitsteilung.

Warum KI-Systeme strukturierte Inhalte bevorzugen müssen

Bei bestimmten Informationen ist „gut geraten“ schlicht nicht gut genug:

- Öffnungszeiten

- Preise

- Stornobedingungen

- Regeln (Hunde, Rauchen, Barrierefreiheit)

Hier reicht Interpretation nicht aus. Hier braucht es klare Signale, die ohne semantische Deutung übernommen werden können. JSON-LD ist deshalb kein Sprachkrückstock für KI, sondern ein Vertrauensanker. Nicht, weil KI Sprache nicht versteht – sondern weil wir ihr sagen müssen, was sie ernst nehmen darf.

Ein Vergleich, der das Problem gut trifft

Stell dir einen Menschen vor, der

- hervorragend lesen kann,

- aber ständig Gerüchte, Meinungen und offizielle Regeln vermischt.

Dann sagst du ihm „Alles, was in diesem Kasten steht, ist offiziell.“. Du beschränkst ihn nicht. Du entlastest ihn. Genau das ist JSON-LD für KI-Systeme.

Wo die eigentliche Stärke der LLMs heute liegt

Die Stärke von LLMs verschwindet durch Struktur nicht – sie verschiebt sich. LLMs sind stark bei:

- Dialog und Beratung

- Kontext über mehrere Interaktionen

- Erkennen von Widersprüchen

- Erklären, Einordnen, Übersetzen

Sie sind nicht dafür gebaut, verbindliche Regeln zu erraten. Deshalb ergibt sich langfristig eine klare Aufteilung:

- Natürliche Sprache → Dialog, Erklärung, Beratung

- Strukturierte Daten → Fakten, Regeln, Verantwortung

Und perspektivisch:

- LLMs werden selbst Struktur erzeugen

- wir liefern nur noch Autoritätssignale

Verstehen vs. Verantwortung

Wir strukturieren Inhalte nicht, weil KI keine Sprache verstehten würde. Wir strukturieren sie, weil wir ihr sagen müssen, was sie ernst nehmen darf, weil Verstehen und Verantwortung nicht dasselbe sind. Die große Ironie unserer Zeit ist daher keine Schwäche der KI, sondern eine Lernkurve auf unserer, der menschlichen Seite. In dem Moment, in dem Maschinen uns verstehen lernen, müssen wir lernen, was wir ihnen verbindlich zusagen wollen – und was nicht.

Strukturierte Daten sind keine Kapitulation vor Maschinenlogik. Sie sind eine Übergangstechnologie zwischen dem Text-Web von gestern und einem Wissens-Web, das Verantwortung kennt.

Beiträge zum Thema Online Marketing:

- Wir können endlich natürlich mit Maschinen sprechen. Hurra! Hurra?

- Gefunden, verstanden, verschwunden?

- Kunden-Avatar: Der Kunde, das bekannte Wesen

- E-Mail-Marketing: Das Powertool im Online Marketing

- Digitales Marketing ist auch bloß Marketing

- My Home is my Castle – die Homepage als zuverlässiger Informationsanker